12月に、また中国に行きました。前回は7月末だったのですが、今回は12月ということで、かなり寒いです。

さて、前回の中国出張のときから気になっていたWeChatでの支払い(WeChatペイメント)にチャレンジしてみました。

WeChatについて

何それ?

WeChatというのは、 中国のメッセージングアプリで、日本のLINEのようなものです。ですが、WeChatは単なるメッセージのやりとりだけでなく、タクシー配車サービスと連携していたり、以前の記事で書いたMobikeというシェアサイクルサービスを利用することもでき、さまざまなサービスのプラットフォームとなっています。

日本のLINEもプラットフォーム構想を打ち出していて、宅急便の再配達の申し込みなどができますが、WeChatはそれをさらに充実させて、かつ国民に広く普及している、という点が特徴です。中国ではスマホ所有者の90%以上がこのWeChatアプリを使っていると言われています。

日本では

日本では、LINEでもLINE Payという機能がリリースされていて、支払いに対応しているのですが、まだまだ普及はしていないように感じます。ApplePayやその他の電子マネーもいろいろありますが(多すぎるぐらい)、どれもまだまだ浸透しているとは言いにくい状況だと感じています。

使い方

使い始めるには

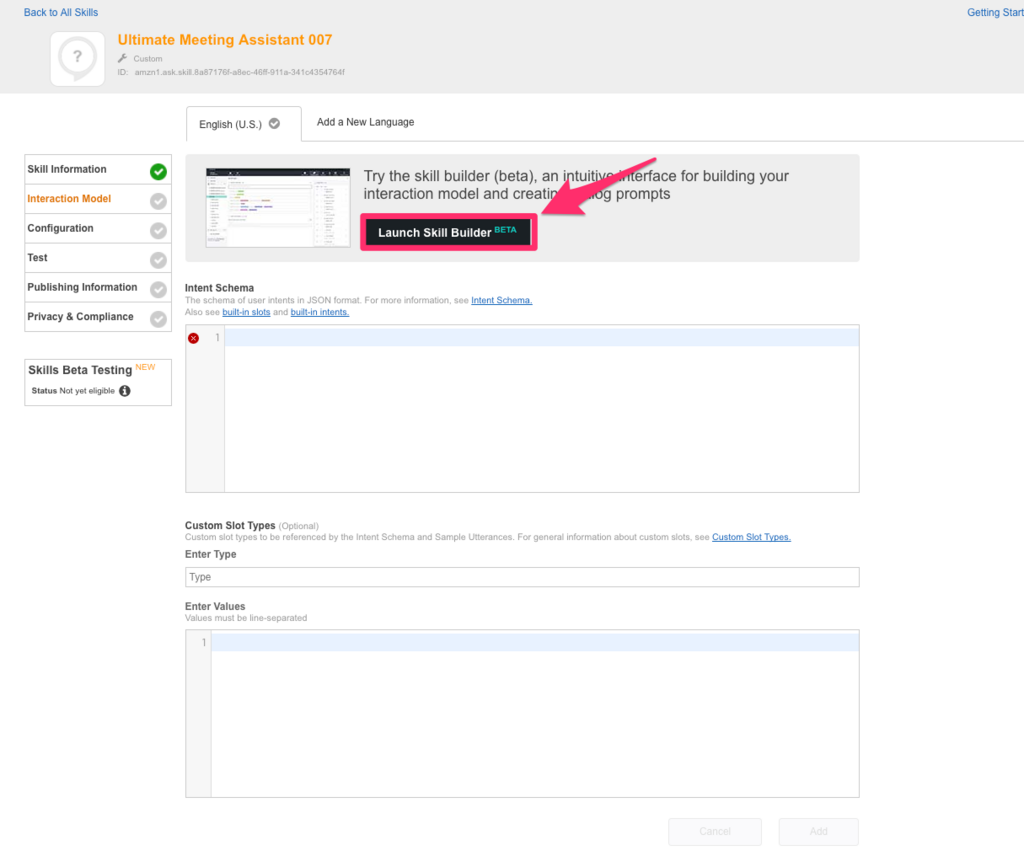

まず、WeChatアプリをインストールします。iPhoneですと、日本のアプリストアからインストールできます。

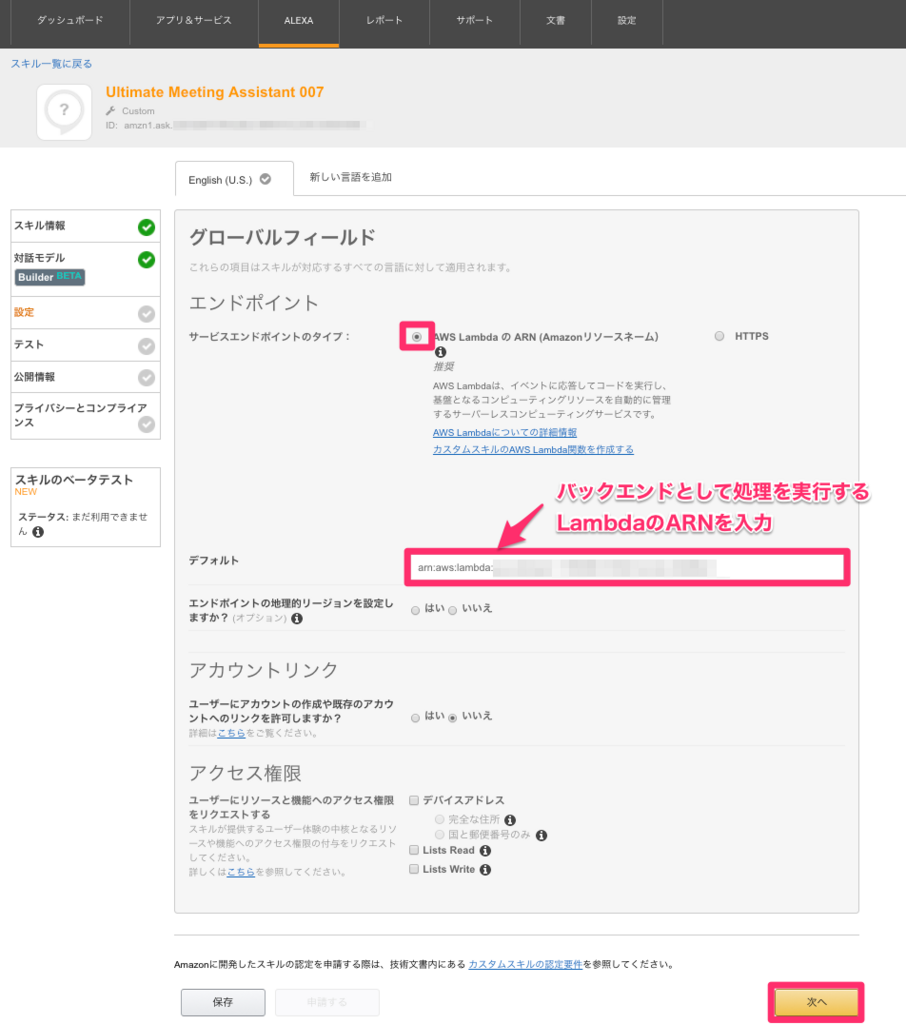

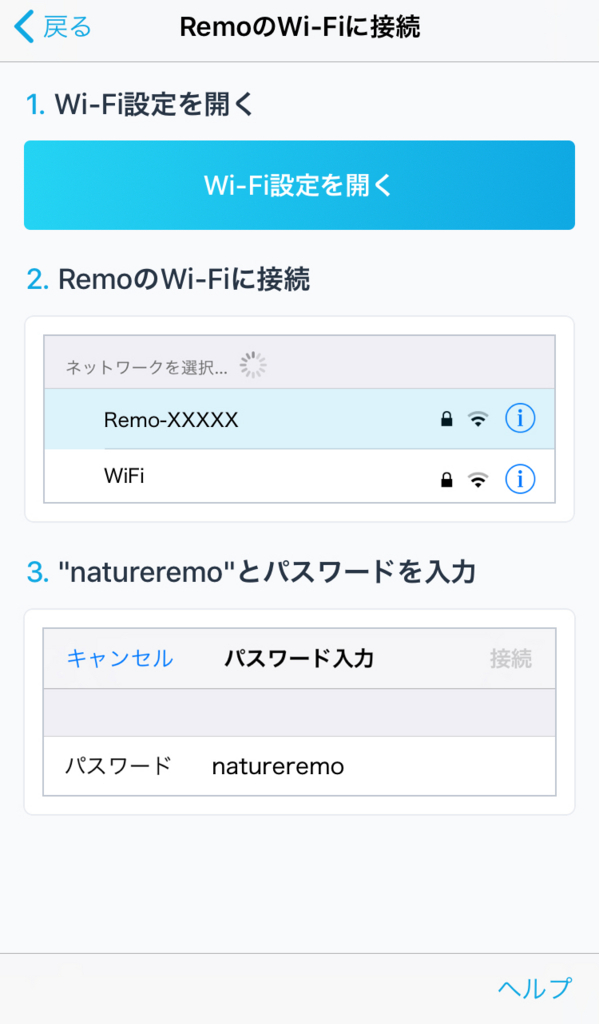

ただし、注意点があります。日本のストアからインストールしたアプリはデフォルトでは制限がかかっているらしく、ペイメント機能に関するメニューが表示されません。また、本来は中国の銀行口座との紐付けが必要になります。ですが、誰かからWeChatで送金してもらうことで日本版アプリで、かつ銀行口座が無くてもWeChatPayが使えるようになります。

詳しくはこのあたりのサイトを参考にしてください。

私は現地の知り合いに現金で100元を渡し、知人から私のWeChatアカウントあてに100元を送金してもらいました。

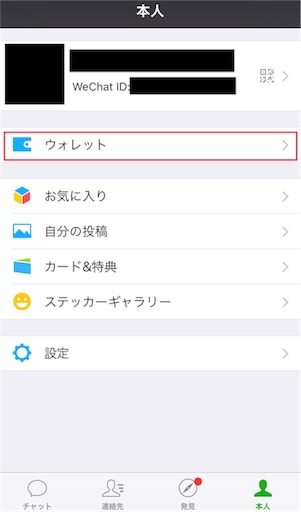

WeChatアプリ下部の「本人」タブを開き、[ウォレット]が表示されればOKです。

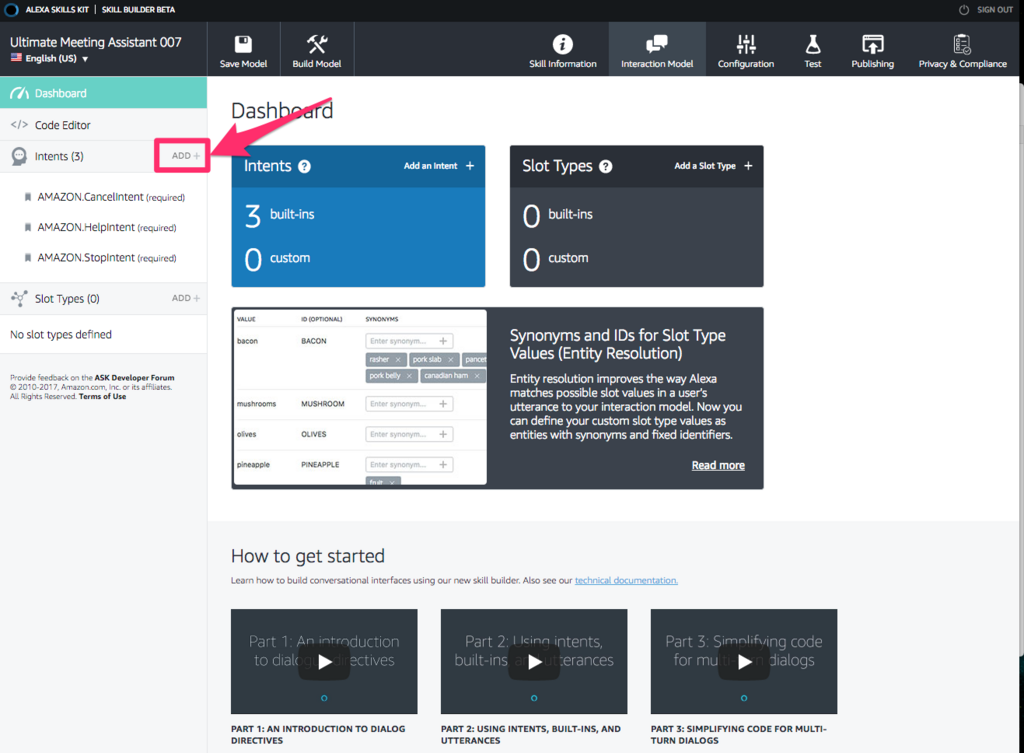

利用方法

WeChatに対応しているお店では、WeChatのアイコンが掲示されていたり、支払い用のQRコードが掲示されていたりするので分かります。

店員さんに「ウェイシン(=微信)」と言うと分かってくれます。"微信"とは、WeChatの中国での正式名称で中国人はみな、「WeChat(ウィーチャット)」とは言わずに、ウェイシンと言います。

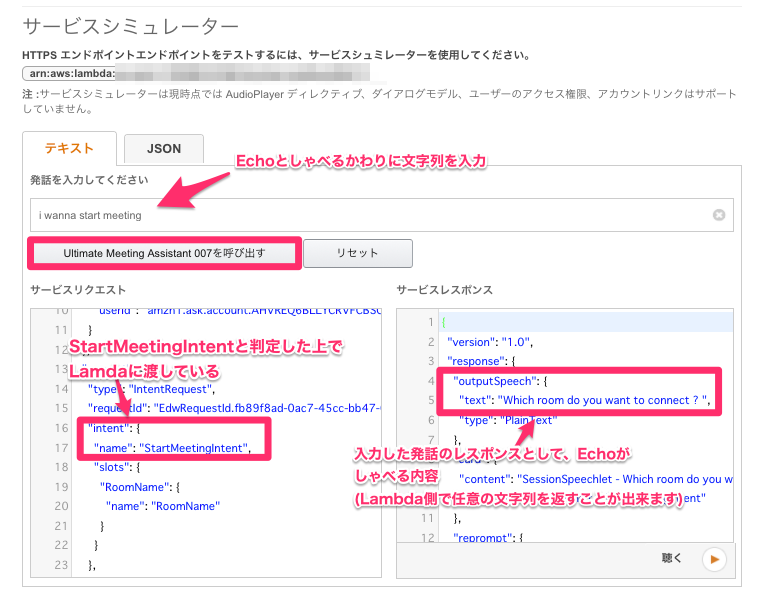

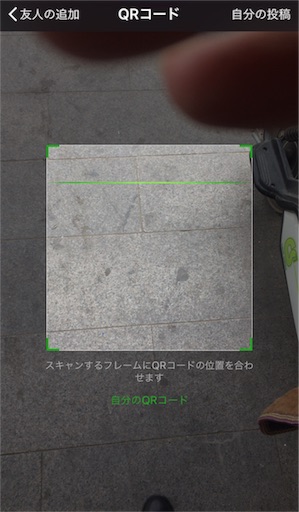

お店にQRコードが掲示してある場合

この場合は、自分のWeChatアプリで店のQRコードを読み取り、表示された画面で支払い金額を入力し、確定ボタンをタッチします。支払パスワードを要求されるので、6桁のパスワードを入力すると、支払いが完了します。

コンビニなどの小さな店舗ではこのパターンが多かったです。

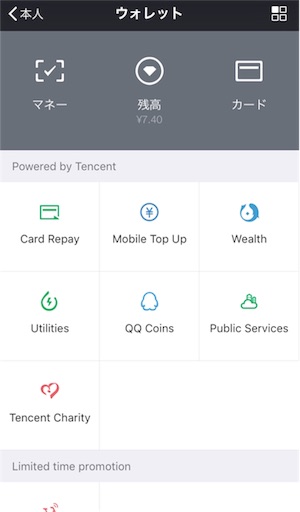

お店側に自分のQRを読み取ってもらう場合

こちらはお店側の人がスマホもしくはQRリーダ(バーコードリーダも)で読み取る場合です。セブンイレブンやスタバなど、ある程度ちゃんとしたお店だとこのパターンが多いようです。

この場合は、WeChatアプリを開き、本人->ウォレットの画面で、左上の[マネー]をタップして表示される画面を、店員さんに見せます。すると、店員さんが画面に表示されているコードを読み取り、支払いが完了します。

この画面を見せるだけ。

いずれの場合も、支払ったあとすぐにアプリに通知が来て、取引履歴が残ります。とても便利です。どこでいくら使ったかが、アプリ上で一目瞭然です。

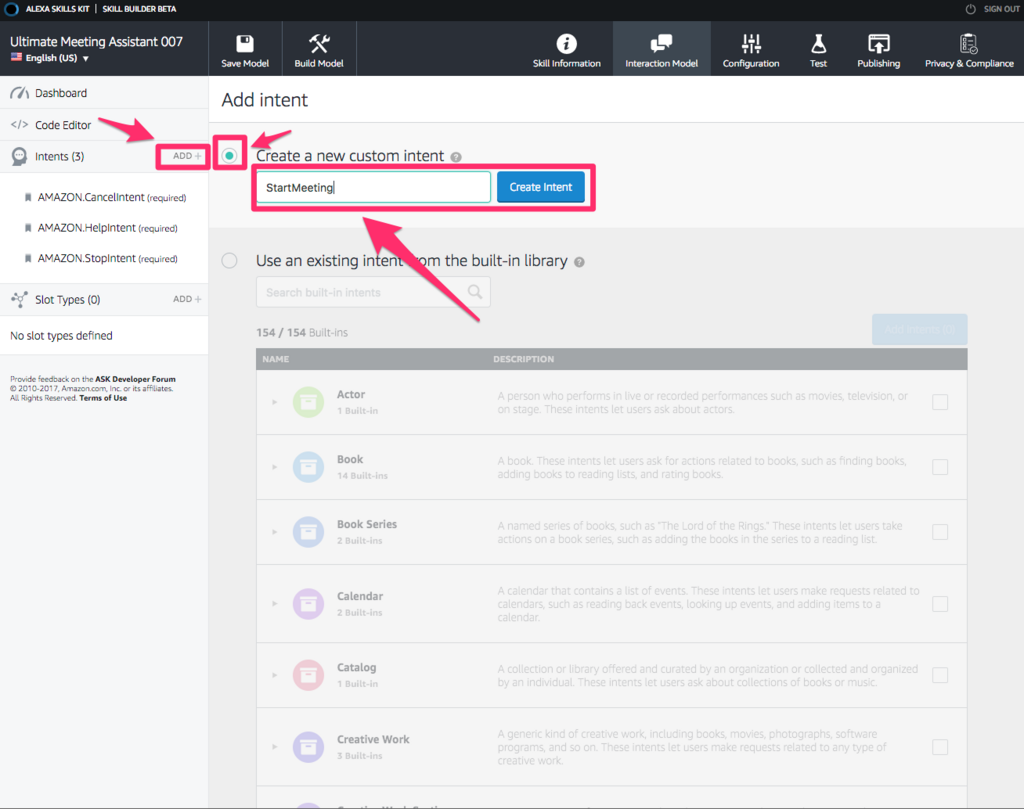

友人に送金する場合

ごはん代を割り勘したときなど、日本だと1人2000円ずつね〜。みたいな感じで現金をやり取りしますが、これもWeChatで対応できます。

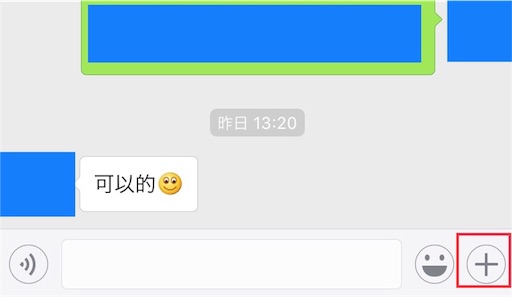

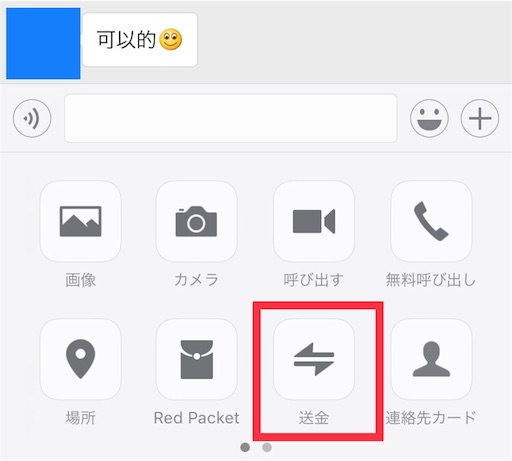

アプリから友人を選び、画面下部のプラスボタンをタップして、

送金をタップします。

金額入力画面が表示されるので、入力して送金を実行するだけ。細かいのがないからあとで、、みたいな事が無いので非常に便利です。

送金のやりとりもチャット上に残り、相手が受け取ったかどうか分かります。

最後に

現金よりもWeChatな理由

日本は現金の信頼性が高く、治安も良いためか、現金での支払いが圧倒的に主流ですね。

アメリカではコンビニでのちょっとした買い物もクレジットカードで支払う人が多かった記憶があります。これは、現金を店に置きたくない、ということも理由の1つのようです。多額の現金を置いておくと強盗に狙われますので。

そして、中国では現金でもクレジットカードでもなく、WeChatやアリペイ(アリババの決済サービス)が主流という感じです。

その背景として、中国でもアメリカなどと同様に、現金はあまり扱いたくない(偽札や安全性の面で)が、かといって国民のかなりの層が、クレジットカードを持てない人たちであるといった事情があるのではないかと考えています。

クレジットカードは信用取引なので、使った分のお金を後払いする形です。でも、収入が安定しない人は信用が低く、カードを使った分、ちゃんと支払えるかが怪しいので、クレジットカードを持っていないのです。

その点、WeChat Payなどは、銀行口座と紐付けてチャージする形で電子マネーを使えるようになるので、借金ではありません。自分が現在所有しているお金以上の支払いはできません。銀行のデビットカードと同じですね。

現金を直接扱わず、かつ信用のない人々でも使えるところがここまで普及したポイントなのでしょう。

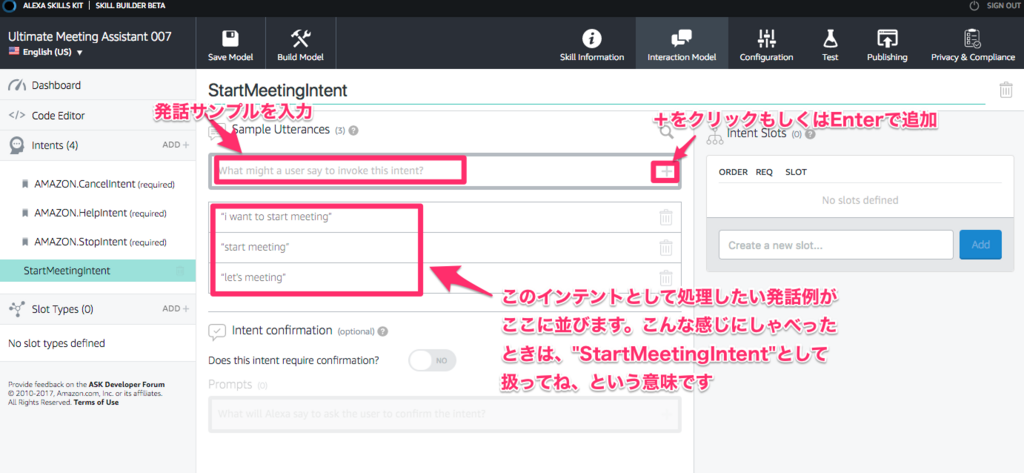

導入も簡単

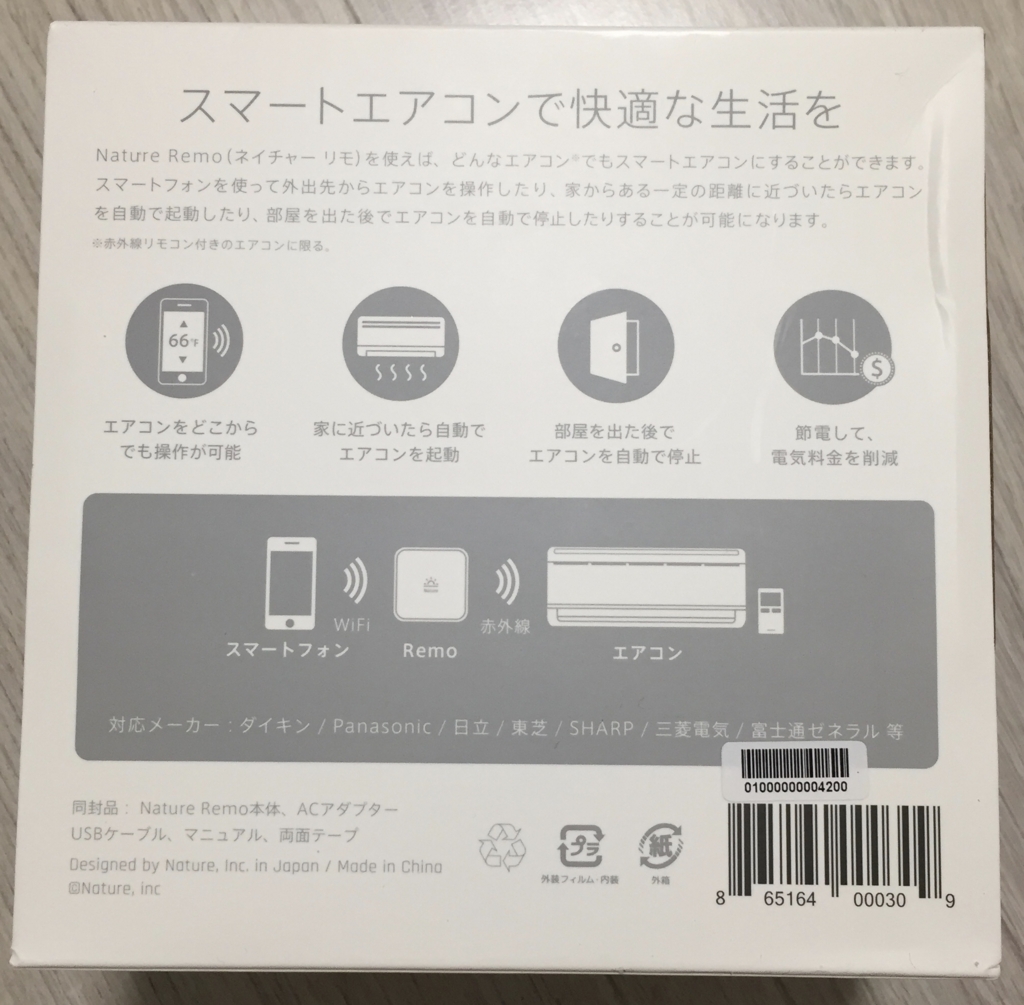

もうひとつ、WeChat Payが広く普及している理由は、店舗やサービス提供側の導入コストの低さ、簡易さだと思います。

クレジットカードや日本の各種電子マネー(WAONとかEdyとかいろいろ)の決済に使用するような専用リーダーは不要で、QRコードを読み取るだけなので、初期コストほぼゼロで導入できます。

また、最近は、店側にQRリーダーが無償で配布され、それをPOSにつないで使用している店舗もあるようです(たぶんスタバはこのパターン)。

日本でもWeChat Payのような便利なサービスが普及するといいですが、やはり有力候補はLINEになるのでしょうかね。個人的には、LINEかApplePayかなと思っています(Googleもかな?)。理由は、やはりできるだけ簡単に使えるから。AppleやGoogleだとスマホそのものやOSと統合できるので少ない操作で決済できそうです。もしくはLINEのように普段から使うアプリで、わざわざインストールしなくても皆が使っているものが広がりやすいと思います。ですが、日本におけるLINE以上に、中国でのWeChatの普及率はすさまじいです。通信キャリアやOSに依存せず、かつ日本企業のプラットフォームアプリが出てくると面白いですね。(楽○は勘弁して。。。)